本文使用kubeasz项目基于二进制方式部署和利用ansible-playbook实现自动化部署K8s。

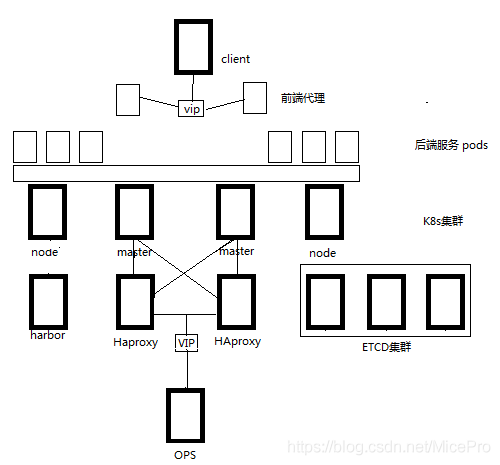

架构图如下所示

根据kubeasz官方文档中高可用集群所需节点配置如下

| 角色 | 数量 | 描述 |

|---|---|---|

| 管理节点 | 1 | 运行ansible/easzctl脚本,可以复用master,建议使用独立节点(1c1g) |

| etcd节点 | 3 | 注意etcd集群需要1,3,5,7…奇数个节点,一般复用master节点 |

| master节点 | 2 | 高可用集群至少2个master节点 |

| node节点 | 3 | 运行应用负载的节点,可根据需要提升机器配置/增加节点数 |

配置集群环境

此次部署节点设置如下:

ansible安装节点&master1:172.18.32.18

master2:172.18.32.19

harbor:172.19.32.20

node1:172.18.32.21

node2:172.18.32.22

etcd1:172.18.32.23

etcd2:172.18.32.24

etcd3:172.18.32.25

haproxy1+keepalived:172.18.32.183

haproxy2+keepalived:172.18.32.184 VIP:172.18.32.250

配置免密登录

先将ansible安装节点也就是master1主机(可以不复用主机)的秘钥分发至各个主机。1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41vim fenfamiyao.sh

!/bin/bash

目标主机列表

PASSWORD="password"

PORT="22"

IP="

172.18.32.18

172.18.32.19

172.18.32.20

172.18.32.21

172.18.32.22

172.18.32.23

172.18.32.24

172.18.32.25

"

[ -a /root/.ssh/id_rsa ] || ssh-keygen -t rsa

which sshpass &> /dev/null || yum install sshpass -y #适用于CentOS

for node in ${IP};do

sshpass -p $PASSWORD ssh-copy-id -p$PORT -o StrictHostKeyChecking=no ${node}

if [ $? -eq 0 ];then

echo "${node} 秘钥 copy 完成,准备环境初始化....."

ssh -p$PORT ${node} "mkdir /etc/docker/certs.d/harbor.hechao.com -p"

echo "Harbor 证书目录创建成功!"

scp -P$PORT /usr/local/src/harbor/certs/harbor-ca.crt ${node}:/etc/docker/certs.d/harbor.hechao.com/harbor-ca.crt

echo "Harbor 证书拷贝成功!"

scp -P$PORT /etc/hosts ${node}:/etc/hosts

echo "host 文件拷贝完成"

scp -r -P$PORT /root/.docker ${node}:/root/

echo "Harbor 认证文件拷贝完成!"

scp -r -P$PORT /etc/resolv.conf ${node}:/etc/

echo "镜像加速链接同步!"

ssh ${node} "mkdir -p /etc/docker"

scp -r -p$PORT /etc/docker/daemon.json ${node}:/etc/docker/daemon.json

else

echo "${node} 秘钥 copy 失败"

fi

done

安装ansible环境

因为要使用ansible批量自动化部署K8s集群,每个主机都要先安装ansible环境。

ubuntu默认的python版本是3.6,而ansible需要python2.7。1

2

3apt update

apt install python2.7

ln -s /usr/bin/python2.7 /usr/bin/python

master1上安装ansible1

apt install ansible

centos一般是自带python2.X环境,所以一般不需要在进行额外操作。

在master1上检查各节点连通性1

ansible all -m ping

配置kubeasz

下载kubeasz

官方文档地址为https://github.com/easzlab/kubeasz,根据适配的K8s版本选择合适的kubeasz版本。根据官方文档,目前支持以下版本

集群版本 kubernetes v1.13, v1.14, v1.15, v1.16

操作系统 CentOS/RedHat 7, Debian 9/10, Ubuntu 1604/1804

运行时 docker 18.06.x-ce, 18.09.x, containerd 1.2.6

网络 calico, cilium, flannel, kube-ovn, kube-router

我们下载2.0.3版本的kubeasz,并给予执行权限1

2curl -C- -fLO --retry 3 https://github.com/easzlab/kubeasz/releases/download/2.0.3/easzup

chmod +x easzup

可以用file easzup命令看到这是一个ASCII文本文件,其实就是一个shell脚本。1

2root@DockerUbuntu18:~# file easzup

easzup: Bourne-Again shell script, ASCII text executable

用vim编辑修改此文件。

大部分地方无需修改,不过可以设置docker版本为18.09.9和K8s的版本为v1.15.5,其他地方不用动。1

2export DOCKER_VER=18.09.9

export K8S_BIN_VER=v1.15.5

执行-- help查看脚本使用方法。1

2

3

4

5

6

7

8

9

10

11

12

13

14

15root@DockerUbuntu18:~# ./easzup --help

./easzup: illegal option -- -

Usage: easzup [options] [args]

option: -{DdekSz}

-C stop&clean all local containers

-D download all into /etc/ansible

-S start kubeasz in a container

-d

-e

-k

-m

-p

-z

see more at https://github.com/kubeasz/dockerfiles

先将/etc/ansible目录下所有自带的配置文件以及hosts文件删掉1

\rm -rf /etc/ansible/*

执行脚本下载所有需要的镜像和二进制文件1

./easzup -D

稍等片刻之后,下载好需要的镜像和二进制文件,此时就可以开始ansible自动部署安装K8s集群了。

ansible部署K8s

kubeasz工具都已经写好了playbook,只需要设定好hosts文件即可一键安装了。先进入/etc/ansible目录,然后复制提供好的host模版文件并编辑。1

2

3cd /etc/ansible/

cp example/hosts.multi-node hosts

vim hosts

1 | root@DockerUbuntu18:/etc/ansible# grep -v ^# hosts|grep -v ^$ |

以为我本地已经搭好harbor服务器了,所以就不要设置harbor服务让他来安装了。除了各节点IP以外,需要修改的就是bin_dir目录,这样就省去了创建软链接的步骤,也省去配置PATH变量了。我选择的网卡是calico,也可以使用默认的flannel,之后具体区别会再详细介绍。

直接执行 playbook剧本90.setup.yml可以直接一键安装完成,不过如果出现问题我们不好排错,推荐一个剧本一个剧本的来跑。

- 01.prepare.yml

1 | ansible-playbook 01.prepare.yml |

这个剧本总共三个环节,一般来说都不会报错(如果提示软链接创建失败,则可忽略)。

1.如果设置了chrony服务器,则master、node、etcd主机都会向chrony服务器同步时间。

2.控制节点上创建CA、创建集群参数及客户端认证参数

3分发证书工具CFSSL及kubeconfig配置文件

- 02.etcd.yml

1 | ansible-playbook 02.etcd.yml |

这个剧本是在配置etcd服务器。在3个etcd节点上,创建etcd目录并分发证书,导入之前下载在控制端的二进制程序etcd及etcdctl及导入etcd的systemctl unit文件,设置开机自动启动etcd服务。这步也很简单,一般也不会出现什么问题。

- 03.docker.yml

因为我们在hosts文件中设置了运行时为docker,所以我们第三个剧本选择03.docker.yml,选择执行03.containerd,yml剧本也不会执行,里面做了条件判断1

2

3

4

5

6

7root@DockerUbuntu18:/etc/ansible# cat 03.containerd.yml

# to install containerd service

- hosts:

- kube-master

- kube-node

roles:

- { role: containerd, when: "CONTAINER_RUNTIME == 'containerd'" }

这个阶段的剧本比较复杂,要在每一个节点上安装docker,在执行这一步之前,先检查一下模版二进制文件的docker版本是否和我们之前预设的一样。1

2/etc/ansible/bin/docker -v

Docker version 18.09.6, build 481bc77

如果不一样,可以去/opt/kube/bin/目录下找一下之前下好的二进制文件,确认下版本。1

//kube/bin/docker -v

这个目录下的版本一般是不会错的,将此目录下的二进制文件复制至模版目录/etc/ansible/bin/。1

cp /opt/kube/bin/* /etc/ansible/bin/

执行ansible剧本1

ansible-playbook 03.docker.yml

- 04.kube-master.yml

这个剧本是对两个master节点操作,执行了以下操作

1.创建kubernetes签名请求以及证书和私钥

2.导入配置文件,启动kube-apiserver、kube-controller-manager及kube-scheduler服务

3.设置主节点的kube-apiserver.service文件,并设置apiserver的IP地址并创建配置用户rbac权限。

此时使用命令kubectl get node可以看到两个主节点都是出于ready状态了。1

2

3

4root@DockerUbuntu18:~# kubectl get node

NAME STATUS ROLES AGE VERSION

172.18.32.18 Ready,SchedulingDisabled master 1m v1.15.5

172.18.32.19 Ready,SchedulingDisabled master 1m v1.15.5

- 05..kube-node.yml

这个剧本主要是将几个node节点加到集群中来。流程比较复杂,大致有以下步骤:

1,创建kube-node目录:/var/lib/kubelet、/var/lib/kube-proxy和/etc/cni/net.d目录

2.导入之前准备好的二进制可执行文件kubectl、kubelet、kube-proxy、bridge、host-local和loopback

3.配置haproxy,监听本地的127.0.0.1:6443端口,代理至两个主节点的6443端口

4.生成node节点的kubelet的配置文件,并分发至各个node节点。kubelet连接主节点的apiserver。

5.node节点连接后,对node节点标记为kubernetes.io/role=node

这步很容易出现kubelet服务无法启动,或者一直处于loaded状态,返回值为255。这是因为node节点的kubelet的认证失败。可以去node节点主机上查看服务kubelet服务状态。1

2systemctl status kubectl

journalctl -u kubelet -e

我遇到几次node节点kubelet无法正常启动的情况,但是换了个全新的node节点就可以加进去了,说明问题不是在主节点上,一般将node节点还原至干净系统都可以解决问题。

还有一次返回值255但报错提示是,找不到/run/systemd/resolve/resolv.conf文件,于是创建一个1

mkdir /run/systemd/resolve/;echo "nameserver 233.5.5.5" > /run/systemd/resolve/resolv.conf

自己创建一个解析之后问题解决。

顺利的话,使用kubectl get node可以看到主节点和node节点都处于ready状态。1

2

3

4

5

6root@DockerUbuntu18:/etc/ansible# kubectl get node

NAME STATUS ROLES AGE VERSION

172.18.32.18 Ready,SchedulingDisabled master 2h v1.15.5

172.18.32.19 Ready,SchedulingDisabled master 2h v1.15.5

172.18.32.21 Ready node 2h v1.15.5

172.18.32.22 Ready node 2h v1.15.5

- 06.network.yml

在这个剧本中,主要是配置各个pod之间的网络访问。需要在每个物理节点上都生成一个calico-node服务的pod,再启动一个calico-kube-controllers服务的pod来管理他们,(因为默认主节点设置了不可调度,所以这个calico-kube-contronllers一般是在node节点上生成)。因为使用的是pod方式启动,所以这个剧本中,除了配置calicao证书及私钥外,主要是生成了一个calico DaemonSet yaml文件,路径为/opt/kube/kube-system/calico.yaml,所以之后如果修改网络配置,可以直接在此路径下修改这个yaml文件,例如如果想要修改镜像地址为私有harbor地址,则1

2

3kubectl delete -f /opt/kube/kube-system/calico.yaml

vim /opt/kube/kube-system/calico.yaml

kubectl apply -f /opt/kube/kube-system/calico.yaml

需要注意的是,如果将yaml文件中拉取镜像的地址改为了私有harbor,则需要在yaml文件中加入Secret资源,使用imagePullSecrets拉取。

当我们的node节点不需要跨网段时,通常会选择将IPIP模式(ip-in-ip叠加模式)关掉,使用calico的BGP模式,以节约大量主机内部访问时封装的性能损耗。

查看路由,可以看到目前荣期间通信的网络接口为tunl0。1

2

3

4

5

6

7

8

9

10

11root@DockerUbuntu18:~# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 172.18.0.1 0.0.0.0 UG 0 0 0 eth0

172.17.0.0 0.0.0.0 255.255.0.0 U 0 0 0 docker0

172.18.0.0 0.0.0.0 255.255.0.0 U 0 0 0 eth0

172.20.185.64 0.0.0.0 255.255.255.192 U 0 0 0 *

172.20.233.128 172.18.32.19 255.255.255.192 UG 0 0 0 tunl0

172.20.250.128 172.18.32.22 255.255.255.192 UG 0 0 0 tunl0

172.20.250.192 172.18.32.21 255.255.255.192 UG 0 0 0 tunl0

192.168.0.0 0.0.0.0 255.255.0.0 U 0 0 0 eth1

于是可以编辑/etc/ansible/roles/calico/defaults/main.yml或者直接修改/opt/kube/kube-system/calico.yaml文件,将其中的 CALICO_IPV4POOL_IPIP修改为off,将name: FELIX_IPINIPMTU属性注释掉,改为FELIX_IPINIPENABLED值为false。1

2

3

4

5- name: CALICO_IPV4POOL_IPIP

value: "off"

- name: FELIX_IPINIPENABLED

value: "false"

然后执行kubectl delete -f /opt/kube/kube-system/calico.yaml将网络组件calico的pod都先停掉,reboot重启后,使用命令ifconfig就会发现,之前使用的tunl0网卡就不见了。再使用命令kubectl apply -f /opt/kube/kube-system/calico.yaml,将k8s网络连接起来,使用命令route -n查看路由信息,就会发现,跨主机通信直接使用eth0网卡了。此时模式从IPIP修改为BGP模式。1

2

3

4

5

6

7

8

9

10

11root@DockerUbuntu18:~# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 172.18.0.1 0.0.0.0 UG 0 0 0 eth0

172.17.0.0 0.0.0.0 255.255.0.0 U 0 0 0 docker0

172.18.0.0 0.0.0.0 255.255.0.0 U 0 0 0 eth0

172.20.185.64 0.0.0.0 255.255.255.192 U 0 0 0 *

172.20.233.128 172.18.32.19 255.255.255.192 UG 0 0 0 eth0

172.20.250.128 172.18.32.22 255.255.255.192 UG 0 0 0 eth0

172.20.250.192 172.18.32.21 255.255.255.192 UG 0 0 0 eth0

192.168.0.0 0.0.0.0 255.255.0.0 U 0 0 0 eth1

- 07.cluster-addon.yml

第七步是安装一些功能插件,如在node节点生成dns解析(默认使用的是coredns,可以在roles/cluster-addon/defaults/main.yml文件中设置),安装dashboard(可视化web界面)。我们也可以选择自己安装这些功能插件。

可参考官方文档https://kubernetes.io/docs/tasks/access-application-cluster/web-ui-dashboard/#deploying-the-dashboard-ui

dashboard默认是1.6.3版本的,比较老。我们这里手动安装dashboard1.10.1版本,过程如下1

2

3

4cd /etc/ansible/manifests/dashboard

mkdir 1.10.1

cp 1.6.3/ui* 1.10.1/

cd 1.10.1

先下载yaml文档1

wget https://raw.githubusercontent.com/kubernetes/dashboard/v1.10.1/src/deploy/recommended/kubernetes-dashboard.yaml

再创建admin tokenvim admin-user-sa-rbac.yaml1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19apiVersion: v1

kind: ServiceAccount

metadata:

name: admin-user

namespace: kube-system

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: admin-user

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: admin-user

namespace: kube-system

创建集群角色vim read-user-sa-rbac.yaml1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: dashboard-read-clusterrole

rules:

- apiGroups:

- ""

resources:

- configmaps

- endpoints

- persistentvolumeclaims

- pods

- replicationcontrollers

- replicationcontrollers/scale

- serviceaccounts

- services

- nodes

- persistentvolumeclaims

- persistentvolumes

verbs:

- get

- list

- watch

- apiGroups:

- ""

resources:

- bindings

- events

- limitranges

- namespaces/status

- pods/log

- pods/status

- replicationcontrollers/status

- resourcequotas

- resourcequotas/status

verbs:

- get

- list

- watch

- apiGroups:

- ""

resources:

- namespaces

verbs:

- get

- list

- watch

- apiGroups:

- apps

resources:

- daemonsets

- deployments

- deployments/scale

- replicasets

- replicasets/scale

- statefulsets

verbs:

- get

- list

- watch

- apiGroups:

- autoscaling

resources:

- horizontalpodautoscalers

verbs:

- get

- list

- watch

- apiGroups:

- batch

resources:

- cronjobs

- jobs

verbs:

- get

- list

- watch

- apiGroups:

- extensions

resources:

- daemonsets

- deployments

- deployments/scale

- ingresses

- networkpolicies

- replicasets

- replicasets/scale

- replicationcontrollers/scale

verbs:

- get

- list

- watch

- apiGroups:

- policy

resources:

- poddisruptionbudgets

verbs:

- get

- list

- watch

- apiGroups:

- networking.k8s.io

resources:

- networkpolicies

verbs:

- get

- list

- watch

- apiGroups:

- storage.k8s.io

resources:

- storageclasses

- volumeattachments

verbs:

- get

- list

- watch

- apiGroups:

- rbac.authorization.k8s.io

resources:

- clusterrolebindings

- clusterroles

- roles

- rolebindings

verbs:

- get

- list

- watch

此时目录结构如下1

2

3

4

5

6

7

8

9root@DockerUbuntu18:/etc/ansible/manifests/dashboard/1.10.1# tree

.

├── admin-user-sa-rbac.yaml

├── kubernetes-dashboard.yaml

├── read-user-sa-rbac.yaml

├── ui-admin-rbac.yaml

└── ui-read-rbac.yaml

0 directories, 5 files

然后通过yaml文件启动dashboard的pod1

kubectl apply -f .

可以通过命令查看pod 是否启动成功。1

kubectl get pods --all-namespaces | grep dashboard

看到状态running之后,输入命令开启认证生成登陆用户名密码1

easzctl basic-auth -s

1 | []basic-auth for apiserver is enabled! |

通过命令kubectl cluster-info查看集群信息来查看登陆url1

kubectl cluster-info

使用命令来获取token1

kubectl -n kube-system describe secret $(kubectl -n kube-system get secret | grep admin-user | awk '{print $1}')

这时就可以登陆web界面查看K8s集群信息了。